[AI] "DeepSeek R1" 모델을 무료로 사용하는 다양한 방법

1. DeepSeek Chat UI

DeepSeek 사이트에서 R1 모델을 무료로 사용할 수 있습니다. 검색 도구도 제공하므로 편리하게 사용할 수 있습니다. 다만, 디바이스 정보, IP 주소, 타이핑 정보 등 수집된 정보가 중국 서버에 저장된다고 하니 사용 시 주의가 필요합니다.

2. Github Marketplace

GitHub Marketplace에 회원가입하고, 웨일 리스트에 신청한 후 승인 메일을 받으면 GitHub에서 제공하는 LLM 모델을 모두 무료로 사용할 수 있습니다.

https://github.com/marketplace/models/azureml-deepseek/DeepSeek-R1

import os

from azure.ai.inference import ChatCompletionsClient

from azure.ai.inference.models import SystemMessage, UserMessage

from azure.core.credentials import AzureKeyCredential

client = ChatCompletionsClient(

endpoint="https://models.inference.ai.azure.com",

credential=AzureKeyCredential(os.environ["GITHUB_TOKEN"]),

)

response = client.complete(

model="DeepSeek-R1"

max_tokens=1000,

messages=[

UserMessage(content="What is the capital of France?"),

],

)

print(response.choices[0].message.content)

3. OpenRouter

OpenRouter에 회원가입하면, free라고 표시된 모델을 무료로 사용할 수 있습니다. 무료 모델이지만 응답 속도가 느린 편이라 사용에는 제약이 있을 수 있습니다.

https://openrouter.ai/deepseek/deepseek-r1:free

from openai import OpenAI

client = OpenAI(

base_url="https://openrouter.ai/api/v1",

api_key="<OPENROUTER_API_KEY>",

)

response = client.chat.completions.create(

model="deepseek/deepseek-r1:free",

messages=[

{

"role": "user",

"content": "What is the meaning of life?"

}

]

)

print(response.choices[0].message.content)

4. Groq Cloud

Groq Cloud에 회원가입하면 Groq에서 제공하는 AI 모델을 무료로 사용할 수 있습니다. Groq에서는 라마 모델 기반의 디스틸된 DeepSeek-R1:70B 모델을 제공합니다.

import os

import openai

client = openai.OpenAI(

base_url="https://api.groq.com/openai/v1",

api_key=os.environ.get("GROQ_API_KEY")

)

response = client.chat.completions.create(

model="deepseek-r1-distill-llama-70b",

messages=[

{

"role": "user",

"content": "What is the meaning of life?"

}

]

)

print(response.choices[0].message.content)

라마 기반이라 그런지, 한국어 응답에 중국어나 영어가 섞여서 나오는 경우가 자주 있었습니다.

5. Together AI

Together AI에 회원가입하면 Together AI에서 제공하는 무료 AI 모델을 사용할 수 있습니다. Groq과 동일하게 라마 모델 기반의 디스틸된 DeepSeek-R1:70B 모델을 무료로 제공합니다.

https://www.together.ai/models/deepseek-r1

from together import Together

client = Together()

response = client.chat.completions.create(

model="deepseek-ai/DeepSeek-R1-Distill-Llama-70B-free",

messages=[

{

"role": "user",

"content": "What are some fun things to do in New York?"

}

],

)

print(response.choices[0].message.content)

무료 모델 뿐만 아니라 다른 모델들도 분당 최대 60건의 요청을 무료로 사용할 수 있습니다.

6. Cerebra AI

Cerebra AI에 회원가입하면 Cerebra AI에서 제공하는 무료 AI 모델을 사용할 수 있습니다. Groq과 동일하게 라마 모델 기반의 디스틸된 DeepSeek-R1:70B 모델을 무료로 제공합니다.

import os

from cerebras.cloud.sdk import Cerebras

client = Cerebras(

api_key=os.environ.get("CEREBRAS_API_KEY")

)

response = client.chat.completions.create(

model="deepseek-r1-distill-llama-70b",

messages=[

{

"role": "user",

"content": "Why is fast inference important?"

}

],

)

print(response.choices[0].message.content)

7. Perplexity

Perplexity Pro 요금제를 이용하면 매달 $5의 보너스가 무료로 지급되므로, 이 비용으로 API를 사용할 수 있습니다. Perplexity에서는 DeekSeek R1 추론 모델을 기반으로한 sonar-reasoning 모델을 출시했습니다.

https://www.perplexity.ai/settings/api

from openai import OpenAI

client = OpenAI(

base_url="https://api.perplexity.ai",

api_key="<PERPLEXITY_API_KEY>",

)

response = client.chat.completions.create(

model="sonar-reasoning",

messages=[

{

"role": "user",

"content": "How many stars are there in our galaxy?"

}

]

)

print(response.choices[0].message.content)

몇 차례 사용해보니 하나의 질문당 약 $0.01 정도의 금액이 차감됩니다. 그러면 한 달에 약 500번 정도의 질문을 할 수 있을 것으로 보입니다.

7. Ollama

Ollama를 PC에 설치하여 DeepSeek R1 모델을 로컬에서 실행할 수 있습니다.

https://ollama.com/library/deepseek-r1

import ollama

response = ollama.chat(

model='deepseek-r1',

messages=[

{

'role': 'user',

'content': 'Why is the sky blue?',

},

]

)

print(response['message']['content'])

DeepSeek-R1:32B 모델부터 사용할 만하며, 맥북 M2, 32GB에서 겨우 돌려볼 수 있었습니다. 안정적으로 동작은 하지만, 질문할 때마다 GPU가 100%까지 올라가서 맥북에서 다른 작업은 하기 어렵습니다.

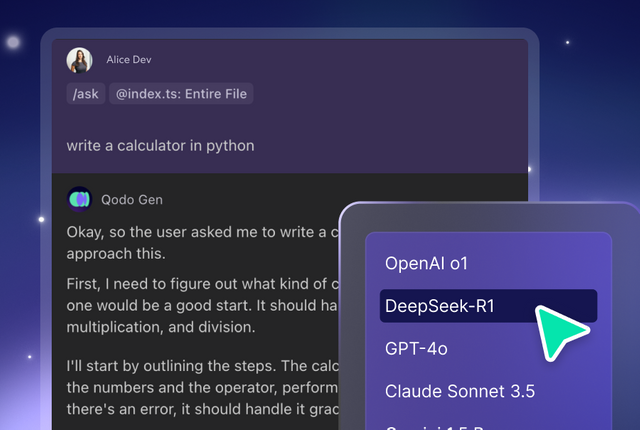

8. VSCode qodo 익스텐션

VSCode 에 qodo 익스텐션을 설치하면 DeepSeek R1 Distill Qwen 32B 모델을 무료로 사용할 수 있습니다.

https://www.qodo.ai/install/vs-code/

이미지 출처: https://www.qodo.ai/blog/qodo-gen-adds-self-hosted-support-for-deepseek-r1/

무료 API인 만큼 요청 한도가 존재하여, 반복적으로 자주 사용하기는 어렵습니다.

저는 Perplexity와 qodo 위주로 사용하고 있습니다.

Upvoted! Thank you for supporting witness @jswit.

안녕하세요. 오늘(2025.02.01) 기준 @jsup 2.0 후원 보팅 현황입니다.

jsup 2.0 - 업보팅을 다시 위대하게

@newiz -> @anpigon : 616.54sp

@jsup에 임대하시면 매일 업보팅을 받으며, 23일후부터 매일 큐레이션/패시브 보상을 받습니다. 후원 내역이 있을 경우 임대량에 합산되어 보팅됩니다. 개발자(@joviansummer) 지원 보팅 외에 수수료가 없어 수익률도 우수합니다. 많은 관심 부탁드립니다. 감사합니다.

중국산은 vpn 필수인듯요 ㄷㄷ

그러게요. 중국 서비스 접속시에는 vpn은 필수로 사용해야할것 같아요.

하지만 저는 vpn으로도 불안해서 아예 사용하지 않으려구요. ㅋㅋ

@devfund-kr 을 후원해주세요