Google Research presents its Project Titans/Google Research presenta su Proyecto Titans

Source

One of the biggest problems with LLM models is what is called the context window, which refers to the number of words that an LLM can remember in a single conversation. If, for example, we have a context window of 4096 tokens, the model will only remember the last 4096 words and will start to forget the first ones.

Uno de los mayores problemas de los modelos LLM es lo que se ha dado en llamar la ventana de contexto, esto se refiere a la cantidad de palabras que un LLM puede recordar en una misma conversación. Si por ejemplo tenemos una ventana de contexto de 4096 tokens el modelo solo recordará las últimas 4096 palabras y empezará a olvidar las primeras.

The latest models, such as Google’s Gemini 1.5 Pro, already have a context window of two million tokens – that is, two million words in a single conversation. This expansion in the capacity of context windows allows models to handle longer texts and maintain consistency in their responses, which is especially useful in applications that require the analysis of large volumes of information or the understanding of complex contexts.

Los últimos modelos, como el Gemini 1.5 Pro de Google, ya tienen una ventana de contexto de dos millones de tokens, es decir, dos millones de palabras en una misma conversación. Esta expansión en la capacidad de las ventanas de contexto permite a los modelos manejar textos más extensos y mantener la coherencia en sus respuestas, lo que es especialmente útil en aplicaciones que requieren el análisis de grandes volúmenes de información o la comprensión de contextos complejos.

Source

However, it is important to note that the increase in the size of the context window also implies greater computational demands and challenges in the efficient management of the processed information. That is why Google has also developed an innovative AI technology called Titans, which is designed to improve the way AI systems manage memory.

Sin embargo, es importante tener en cuenta que el aumento en el tamaño de la ventana de contexto también implica mayores demandas computacionales y desafíos en la gestión eficiente de la información procesada. Por eso, también desde Google, han desarrollado una innovadora tecnología de IA llamada Titanes, que está diseñada para mejorar la forma en que los sistemas de IA gestionan la memoria.

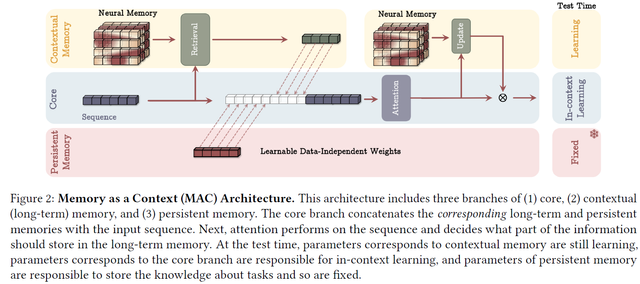

This technology is based on a dual architecture that combines two types of memory, one short-term similar to the RAM of a computer, this memory stores information that is accessed quickly for immediate tasks and another long-term memory, similar to the hard drive of a computer, this memory stores information more permanently and in greater quantities.

Esta tecnología se basa en una arquitectura dual que combina dos tipos de memoria, una a corto plazo similar a la memoria RAM de una computadora, esta memoria almacena información a la que se accede rápidamente para tareas inmediatas y otra memoria a largo plazo, similar al disco duro de una computadora, esta memoria almacena información de forma más permanente y en mayor cantidad.

Source

By combining these two types of memory, AI models can perform more complex tasks and analyze long documents more effectively. This is because they can access relevant information from long-term memory while working on immediate tasks that require short-term memory. Titans are expected to have a significant impact on various AI fields such as natural language processing, scientific research, and the development of virtual assistants.

Al combinar estos dos tipos de memoria, los modelos de IA pueden realizar tareas más complejas y analizar documentos extensos con mayor eficacia. Esto se debe a que pueden acceder a información relevante de la memoria a largo plazo mientras trabajan en tareas inmediatas que requieren memoria a corto plazo. Se espera que Titanes tenga un impacto significativo en diversos campos de la IA como el procesamiento del lenguaje natural, la i investigación científica y el desarrollo de asistentes virtuales.

While Titans is a promising technology, it still faces challenges, such as high computational cost and the complexity of implementing this architecture on existing systems. However, Google is working to overcome these challenges and make Titans accessible and useful for a wide range of applications. Despite the challenges, Titans’ potential to transform the way we interact with AI is undeniable.

Si bien Titanes es una tecnología prometedora, aún enfrenta desafíos, como el alto costo computacional y la complejidad de implementar esta arquitectura en sistemas existentes. Sin embargo, Google está trabajando para superar estos desafíos y hacer que Titanes sea accesible y útil para una amplia gama de aplicaciones. A pesar de los desafíos, el potencial de Titanes para transformar la forma en que interactuamos con la IA es innegable.

More information/Más información

https://aipapersacademy.com/titans/