Parámetros y estimadores estadísticos

Entonces decides hacer un estudio estadístico y así preguntarle unas 2000 personas cuántos kilos de café consumen al mes, pues con el promedio de kilos mensual podrías tener una idea de si la demanda de café por parte de la población es favorable para tu futura tienda.

Sin embargo, entre 12.000 y 2.000 personas hay mucha diferencia, ¿cómo podemos asegurar que la respuesta de esas 2.000 personas realmente representa la tendencia del total de la población? Para esto, la estadística hace uso de una herramienta poderosa: los estimadores.

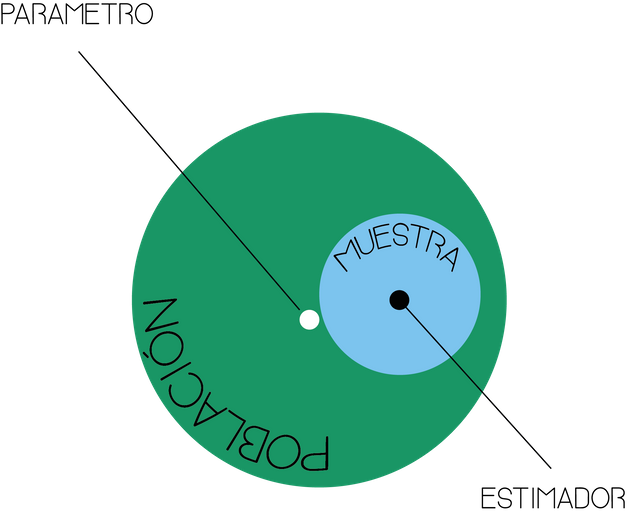

Los estimadores existen para caracterizar a una población específica, que en este caso serían las 12000 personas de la urbanización, a partir de una muestra tomada la misma, es decir, un pedacito de esa población, (las 2000 personas que han de ser encuestadas).

Esta caracterización se realiza resumiendo la información que obtenemos de un conjunto de valores a un solo valor específico. En el caso de una población completa, a esta caracterización le llamamos parámetro; por otro lado, al valor resultante de la caracterización de la muestra que tomamos de una población lo llamamos estimador.

Los estimadores regularmente se representan con un ^ encima del símbolo con que representemos el parámetro que queremos estudiar. Si representamos nuestro parámetro con z, entonces, nuestro estimador será ẑ.

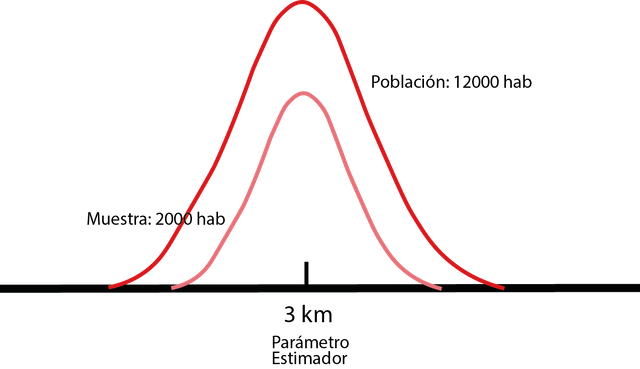

Volvamos a nuestro ejemplo de la tienda de café para entender esto último. Supongamos que tenemos mucho dinero y nos alcanza para pedirle a una encuestadora que realice un estudio estadístico para la población completa de la urbanización, es decir, para los 12000 habitantes. Los resultados arrojan que, en promedio, ellos consumen 3 kilos de café al mes.

Como estamos haciendo el cálculo con la población total entonces, nuestro promedio de 3 kilos al mes es un parámetro.

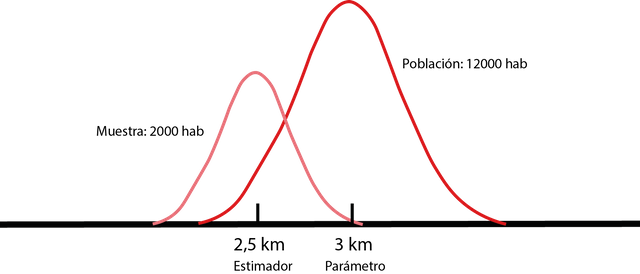

Ahora, supongamos que no tenemos tanto dinero como para pagarle a la encuestadora un estudio con una población de 12000 personas porque resulta sumamente costoso, así que le pedimos que mejor realice el estudio tomando una muestra de 2000 habitantes, (que era lo que queríamos estudiar en un principio) para luego hacer una aproximación a la población total. El resultado nos da que en promedio las personas de la muestra consumen 2,5 kilos mensuales de café, en este caso el resultado es un estimador.

Repasemos brevemente: el parámetro es un valor exclusivo asociado a la población total mientras que los estimadores están asociados a una muestra tomada de dicha población.

En la vida real, cuando tratamos con poblaciones muy grandes es poco probable que logremos dar con el valor real de un parámetro, por lo tanto, los parámetros terminan considerándose como un valor teórico.

Tipos de estimadores

Existen varios tipos de estimadores en la estadística. Los más usados son la media (el promedio), la moda (el valor que más se repite), y la mediana (el valor central de un grupo ordenado). Sin embargo, cada uno aporta un tipo de información distinta por lo que es de suma importancia elegir adecuadamente el que vamos a usar dependiendo de lo que necesitemos hacer.

Para conseguir un estudio estadístico realmente efectivo debemos procurar que el valor del estimador de nuestra muestra se lo mas cercano posible al valor del parámetro de la población que elegimos. Esto se debe a que la estadística persigue predecir el comportamiento de grandes masas de datos a partir del análisis de una muestra pequeña de los mismos, y para esto nos conviene que tanto la población como la muestra se comporten de manera semejante.

Sesgo

Los estimadores suelen ir acompañados de un atributo llamado sesgo. El sesgo se refiere a la existencia de una diferencia entre el valor del parámetro de la población y el valor del estimador en su respectiva muestra.

En nuestro ejemplo, el sesgo viene a representar la diferencia que hay entre los 3 kilos mensuales que en promedio toma la población total de la urbanización versus los 2,5 kilos mensuales que consumen las 2000 personas encuestadas.

La existencia del sesgo se traduce como la presencia de un error en los resultados obtenidos, es decir, te indica que tu población y tu muestra no se comportan de la misma manera y que, por tanto, los resultados que estimaste no son del todo fiables.

Se define de la siguiente forma:

A partir del sesgo podemos clasificar a los estimadores en dos grupos.

Estimador insesgado

Se define formalmente de la siguiente forma

Si ẑ es un estimador puntual de un parámetro z, entonces ẑ es insesgado si

Lo que significa que un estimador es insesgado si es igual a parámetro. En este caso, el valor que estimamos es altamente confiable.

Por otro lado, si E(ẑ)≠ z entonces el estimador es sesgado y el valor arrojado no resulta confiable, puesto que no se aproxima lo suficiente al valor teórico del parámetro poblacional.

Apliquemos esto a nuestro ejemplo del café. Tenemos que la encuestadora nos arrojó que el parámetro es igual a 3 kilos mensuales de consumo por persona, mientras que nuestro estimador es de 2,5 kilos.

z =2,5 kg

Ahora, comparemos ambos resultados.

Por lo tanto, nuestro estimador de 2 Kg es sesgado, puesto que no es igual al parámetro.

Otra característica de los estimadores es la consistencia. Esta se refiere a la relación que existe entre la aproximación del valor de un estimador al valor del parámetro y el aumento del tamaño de la muestra.

Y por último tenemos la eficiencia, la cual esta asociada a que tan grande es la varianza de un estimador.

El sesgo, la consistencia y la eficiencia son características que usamos para comparar estimadores y así definir cual nos es más útil al momento de realizar análisis estadísticos. Los mejores estimadores son aquellos que tienen menor sesgo, mayor consistencia y mayor eficiencia (es decir, menor varianza o menor dispersión en los datos).